明治大学 理工学部 情報科学科 林研究室

教授 博士(工学) 林 陽一

〝結論だけ示す〞が許されない時代

社会においてディープラーニング(以下DL)の実装が進み、AIによって様々なサービスが便利に利用できるようになった。その一方で、看過できない問題も指摘されている。DLの〝ブラックボックス〞問題だ。

そもそもDLとは、ビジネスなどのプロセスを自動化する技術だ。大量のデータからコンピュータが知識を自動的に習得することを大きな特徴としているため、「思考の過程が追えない」、すなわち「AIがなぜその結論に至ったか人間が理解できない」というリスクを伴う。AI発展に付随するこの問題について、世界で初めて指摘した人物が、明治大学の林陽一教授である。

「私が問題を提起したのは、1990年のこと。その後、DLの原型であるニューラルネット(以下NN)学習におけるブラックボックス問題を解決する独自技術などを研究してきました」

ブラックボックス性の最大の問題は、〝判断を下した根拠〞の説明が得られないことにより、医療などクリティカルな領域への応用が難しくなることだ。そのため、現在のAIの応用範囲は極めて限定的である。この問題の解決には、「〝根拠を説明する能力を持ったAI〞の開発が不可欠です。現代は結論だけ述べるのが許されない時代」と林教授は強調する。

「学習プロセスで重視した部分に色付けなどして示すアプローチがありますが、それは単に〝どこを見たか〞を示しているに過ぎず、根拠を説明していることになりません。求められているのは、判断の仕組みがわかる学習モデルを備えた『ホワイトボックスAI』です」

90年代の問題提起から約20年NN学習におけるブラックボックス問題はほぼ解決したが、近年、DLにおいてその問題が再燃しているという。

「NNでの問題解決を可能にしたのは、近年確立した『ルール抽出化』という技術。NNのブラックボックス状態をホワイトボックス化する技術で、この技術がDLに応用できることが理解されておらず、ブラックボックス問題解決の停滞を招いています。当研究室では、ブラックボックスの中身をわかりやすい簡潔なルールの集合で表現してホワイトボックス化するルール抽出技術の研究を推進し、医学や金融工学など、多方面で成果を上げています」

日本の高信頼AIが世界を席巻する日

「周回遅れ」‒‒‒ 正解と比して日本のAIの研究・実用化の現状を指してそう評されるが、「ホワイトボックスAIは、形勢逆転をもたらす可能性を秘めている」と林教授は力説する。

「ホワイトボックスAIの根幹をなすルール抽出技術は応用範囲が極めて広く、生化学検査データや故障診断データ、プラントの操業データなどの数値データだけでなく、一定条件下で、画像をDLで学習して要点をルールで表現するDL版のルール抽出技術も可能にしています。この技術では日本が先行しており、研究を推進していけば、説明可能なホワイトボックスAIはいずれ必ず実現できるはず」

ミッションクリティカルな領域を筆頭に、多くの分野では、AIがホワイトボックス化されていないことがネックとなって、AIが十分に活用されていない。林教授は、「もしAIがホワイトボックス化されれば、AIの適用範囲を現在の数十倍に拡大することができると考えています」と胸を張る。

日本の工業製品の信頼性の高さは世界中から評価されているが、DLのブラックボックス性の解消を日本が実現すれば、「それこそ誰もが理解して信頼でき、そして管理できる日本製AIが誕生する」と林教授。

「マンパワーやコンピュータパワーでは米中に敵いませんが、彼らが思いもつかないようなルール抽出技術による〝高信頼〞なホワイトボックスAIによる新たなビジネスインテリジェンスを、自動車から健康科学、医学、化学工学、創薬、デジタルマーケティングまで幅広く展開すれば、日本はAI分野で優位に立てると信じています」

日本製高信頼AIが世界を席巻する日を目指し、林研究室は今日も独自研究に余念がない。

DL透明化技術で世界をリードする林教授。画像の説明能力の大幅向上、医用画像診断などで独創的な研究に取り組む

注目の研究

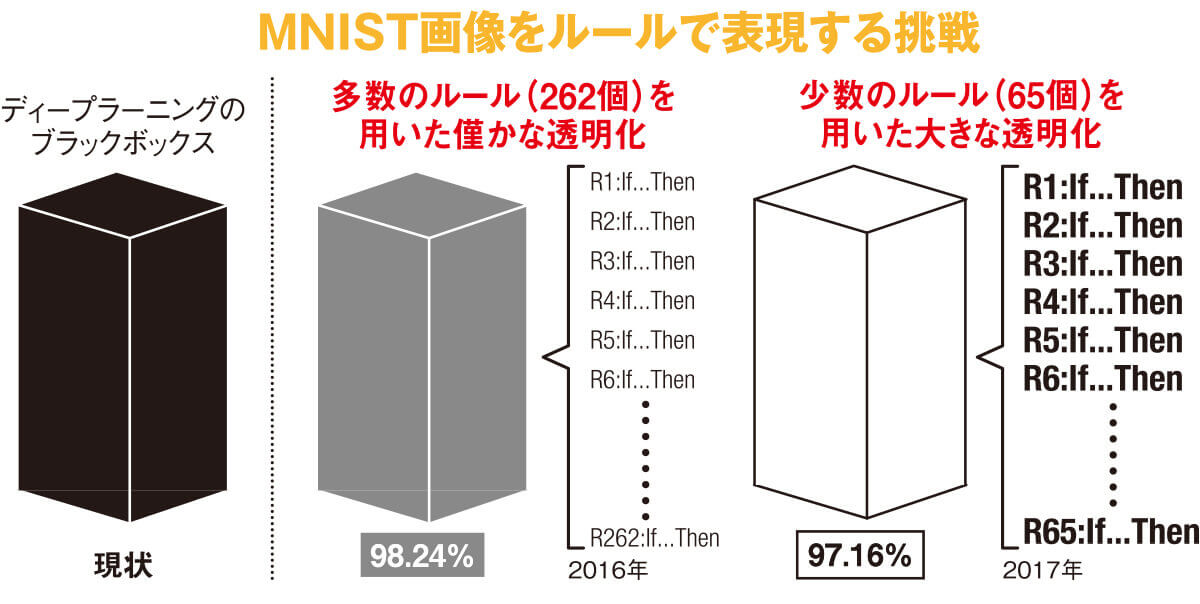

ディープラーニングのブラックボックス性解消のカギとなるルール抽出技術は、もともとニューラルネットワーク用に考案されたもの。過去30年間、その問題を解決するために、多くの研究者によって努力がなされ、近年、その有望な手段として、分類精度と解釈可能性のバランスが取れたルール抽出技術が提案された。林教授は、ニューラルネットで確立された分類精度とルールのわかりやすさをバランスさせるルール抽出技術のディープラーニングへの応用を進めており、上図は、その技術によるホワイトボックスAIのイメージ。左端は現状の不透明(ブラックボックス)なディープラーニング。ルール抽出技術でブラックボックスが透明化していくプロセスを表している。現在、ルール数の削減等による説明能力の向上に取り組んでいるという

林陽一

教授 博士(工学)

はやし・よういち/1984年、東京理科大学大学院理工学研究科経営工学専攻博士課程修了。オムロン株式会社中央研究所など勤務を経て、86年、茨城大学工学部専任講師(情報工学科)。90年、同大学助教授。同年、米国アラバマ州立大学バーミングハム校客員准教授。94年、明治大学理工学部専任助教授(情報科学科)。96年、同大学専任教授。現在に至る。

コメント